Modèles de diffusion : Un nouvel horizon dans la génération d’images

Lorsque le rideau est tombé l’année dernière, la plupart des conversations sur l’IA générative dans les forums publics et les médias tournaient autour de la création de texte, des noms comme chatGPT volant la vedette. La réalité est cependant que le pouvoir de transformation de l’intelligence artificielle, menée par le deep learning, va bien au-delà du domaine des mots. Un exemple remarquable est la génération d’images, qui est devenue un domaine vivant d’exploration et d’innovation dans le monde de l’IA.

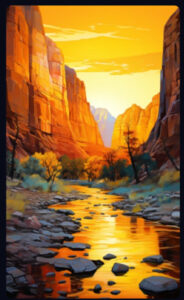

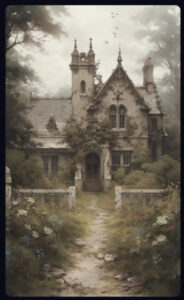

Ces outils pilotés par l’IA, connus sous le nom de modèles génératifs, ont porté la création d’images à un niveau supérieur, produisant des images non seulement réalistes, mais aussi souvent captivantes dans leurs détails. Ils ont même pénétré le domaine de l’art et du design, repoussant les limites de ce qui est possible avec la technologie.

Dans la série de ces modèles générateurs d’images, quelques noms se distinguent particulièrement : Les encodeurs automatiques variationnels (VAE), les modèles basés sur les flux et les réseaux adversaires génératifs. Mais parmi ces joueurs, l’un d’entre eux a fait des vagues silencieuses en raison de ses capacités uniques : le modèle de diffusion.

Si vous vous intéressez aux modèles d’IA capables de générer des images uniques et réalistes, voici une introduction au monde des modèles de diffusion et à leurs applications dans la génération d’images.

La science derrière les modèles de diffusion

Les modèles de diffusion sont un type d’IA qui génère de nouvelles choses, comme des images, en imitant un processus similaire au mouvement aléatoire de minuscules particules dans un liquide. Cela peut paraître complexe, alors décomposons-le.

Imaginez que vous avez une image claire. La tâche du modèle de diffusion consiste d’abord à ajouter progressivement du « bruit » visuel aléatoire à l’image, jusqu’à ce qu’il ne reste plus que des taches aléatoires et désordonnées, comme le bruit sur un écran de télévision. La conversion d’une image claire en ce bruit bruyant est contrôlée par une série de règles connues sous le nom d’équation différentielle stochastique (SDE).

Pour créer une nouvelle image, ce processus est inversé. En partant d’un échantillon de la distribution du bruit, le modèle applique l’inversion de la SDE pour transformer à nouveau le bruit en une image significative.

Comment sait-il comment s’y prendre ? Eh bien, pendant l’apprentissage, le modèle apprend comment passer du bruit à une image significative en essayant constamment de minimiser la différence entre ses images nouvellement créées et les images réelles de son ensemble de données d’apprentissage.

En bref, les modèles de diffusion créent de nouvelles images en transformant d’abord des images claires en bruit, puis en reconvertissant habilement ce bruit en images claires et significatives.

Pourquoi les modèles de diffusion sont-ils importants ?

Les modèles de diffusion s’avèrent révolutionnaires, car ils produisent des images impressionnantes et de grande qualité tout en permettant un contrôle à grain fin du processus de création. Contrairement à leurs homologues, les GAN (Generative Adversarial Networks) ou les VAE (Variational Autoencoders), les modèles de diffusion disposent d’un objectif d’apprentissage clair et bien structuré, ce qui contribue à éviter les problèmes fréquents, tels que l’effondrement du mode, auxquels sont souvent confrontés les autres modèles génératifs.

Ce qui distingue les modèles de diffusion des autres modèles est leur approche progressive, qui permet de générer des images à différentes résolutions. Cette polyvalence est incroyablement précieuse pour des tâches telles que l’amélioration de la résolution d’une image ou le remplissage de parties manquantes d’une image. Les images générées par ces modèles sont non seulement d’une qualité visuelle exceptionnelle, mais offrent également des possibilités passionnantes dans toute une série de domaines, notamment les jeux vidéo, la réalité virtuelle et même l’industrie cinématographique.

Modèles de diffusion populaires

- Dall-E 2 d’OpenAI[1]

- Imagen de Google[2]

- Diffusion stable de StabilityAI[3]

- Midjourney[4]

En résumé, les modèles de diffusion se sont créés une niche dans le domaine de l’intelligence artificielle grâce à leurs capacités uniques de génération d’images. Si les recherches se poursuivent, nous pouvons nous attendre à des applications encore plus impressionnantes et variées de ces modèles dans un avenir proche. Ils constituent une étape supplémentaire sur la voie de l’apprentissage automatique et de l’intelligence artificielle, qui dessine une image prometteuse de l’avenir.

Références

[1] https://openai.com/dall-e-2

[2] https://imagen.research.google/

Create PDF

Create PDF

Contributions en tant que RSS

Contributions en tant que RSS

Laisser un commentaire

Rejoindre la discussion?N’hésitez pas à contribuer !